ALIGN Webinar Series

In this ALIGN Webinar Series, we invite leading researchers and field builders in AI Alignment / AI Safety to share their insights and expertise. In the latter part of each episode, we engage in an interactive discussion with participants.

ALIGN Webinarシリーズでは、AIアライメント/AIセーフティの分野で先導的な研究者や実践者をゲストに招き、講演と参加者を交えた議論を行います。

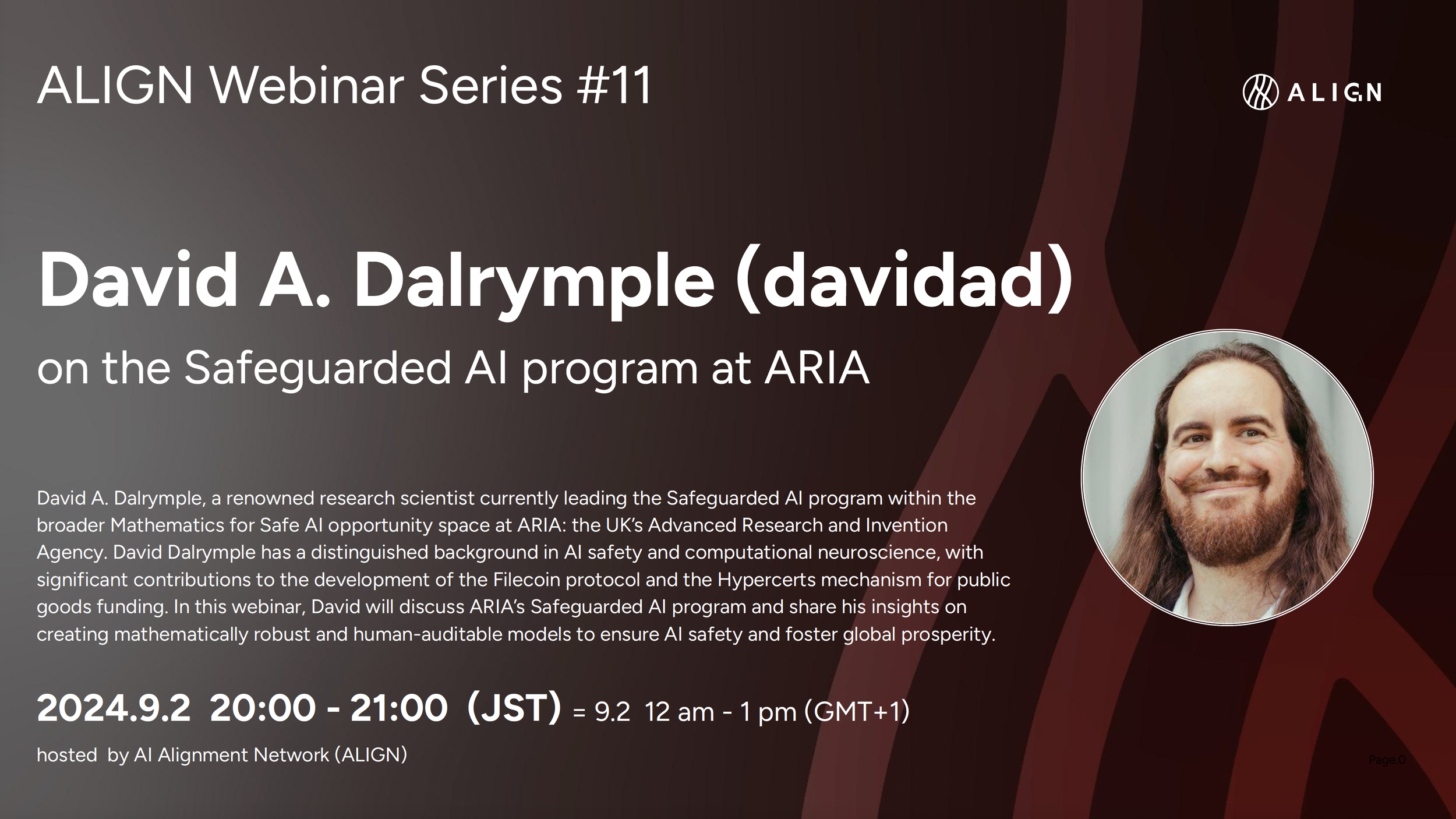

#11 David Dalrymple (davidad) on Mathematics for Safeguarded AI program at ARIA

In the eleventh episode of the ALIGN webinar series, we are pleased to invite David A. Dalrymple, a distinguished research scientist with extensive experience in AI safety and computational neuroscience. David will share his insights on ARIA’s Safeguarded AI and his latest views on AI safety.

#10 LLMのアライメント技術 ゲスト:今井翔太さん(AI研究者)

東京大学松尾研究室にてAI研究に従事され、現在は新たな挑戦に向けて準備中の今井翔太さんをお迎えします。今井さんは、強化学習、マルチエージェント、生成AI、LLM、ゲームAIなどを専門に研究を展開され、2024年1月には、単著『生成AIで世界はこう変わる』(SB新書)を刊行されました。本ウェビナーでは、強化学習(RLHF)を中心とした、大規模言語モデルのアライメント技術について解説いただきます。

#9 Dr. Albert Webson on A Brief History of Pretraining and Post-Training LLMs

In the ninth episode of the ALIGN webinar series, we will invite Dr. Albert Webson, a senior research scientist at Google DeepMind. He will share an overview of the main components of contemporary LLM pretraining and post-training (SFT and RLHF), including their connections to the history of alignment.

#8 SFから考える未来のAIリスク (ゲスト:大澤博隆さん)

慶應義塾大学理工学部准教授、日本SF作家クラブ第21代会長の大澤博隆さんをお迎えし、SFが未来のAIをどのように描いてきたのか、そうしたSFによるAIリスクの描かれ方から我々が学び取れることは何かについて考えます。

#7 「テクノロジーの〈解釈学〉」から考えるAI (ゲスト:小林茂さん(IAMAS))

情報科学芸術大学院大学(IAMAS)教授の小林茂さんをお迎えし、AIと人間の関係を日本で考えるうえでポスト現象学や基礎情報学といった哲学的道具立てがもたらしてくれる視点について、小林さんが近年展開する「テクノロジーの〈解釈学〉」を軸にトークいただきます。後半では、ALIGNの高橋代表理事とのクロストークにて、AIアライメントの研究実践との接点を考察します。

#6 Evan Hadfield on AI and Democracy

In the sixth episode of ALIGN webinar series, we invite Evan Hadfield, Projects Director of the Collective Intelligence Project (CIP) and a specialist in Human Computation. Collective Intelligence attempts to optimize all elements of “transformative technology trilemma”: participation, progress, and safety, effectively overcoming problems and limitations seen in capitalist acceleration, authoritarian technocracy, and shared stagnation. We will hear from Evan about ways to democratize AI.

#5 「AIガバナンスとフェアネス」(ゲスト:工藤郁子さん)

今回のウェビナーでは、AI技術について法学と国際ルール形成の観点から見てこられた工藤さんより、近年のAIガバナンスの状況について、また、AIの破局的・長期的リスクに関する近年の言説や見通しについても所感も伺い、オーディエンスを交えた議論を行います。

#4 Dr. Ryan Kidd on the State of AI alignment field building: learning from MATS and LISA

In this ALIGN Webinar, we invite Dr. Ryan Kidd, Co-Director of ML Alignment & Theory Scholars (MATS) and Co-Founder & Board Member of the London Initiative for Safe AI (LISA). Ryan will discuss the brief history and accomplishments of MATS and LISA, provide an overview of the rapidly evolving field of AI alignment and what steps should be taken now, and offer his advice on field building in Japan.

ML Alignment & Theory Scholars (MATS) の共同ディレクターであり、London Initiative for Safe AI (LISA) の共同創設者のRyan Kidd 博士をお招きします。Ryan氏はクイーンズランド大学で物理学の博士号を取得後、AI アライメントの分野構築(field building)に尽力されてきました。MATSプログラムは、若手研究者にAIアライメント分野に参入するための教育プログラムを提供することで、分野の発展に大きく貢献してきました。LISAはロンドンで活気あるコミュニティを形成しています。本ウェビナーでは、MATSとLISAの歩みとその成果について、急速に発展するAIアライメント分野の向かう先について、伺います。

#3 Dr. Evan Miyazono on Atlas Computing’s path to general AI with safety guarantees

We invite Dr. Evan Miyazono, CEO of Atlas Computing, a nonprofit developing AI tools with safety guarantees through the use of an architecture based on formal methods. In this webinar, we will hear from Evan about Atlas Computing’s approach to reducing AI risk, why they’re starting by building tools for formal verification, and his metascientific view on the direction of the AI safety field.

2023年に創設された非営利組織Atlas ComputingのCEO、Evan Miyazono博士を招きします。形式検証の手法に基づいた安全保証付きのAIの開発を目指すAtlas Computingを創設した狙いや、そしてMiyazono氏が長年取り組んできたメタサイエンス的視点から見たAI Safety分野の今後の発展の見通しについて伺います。

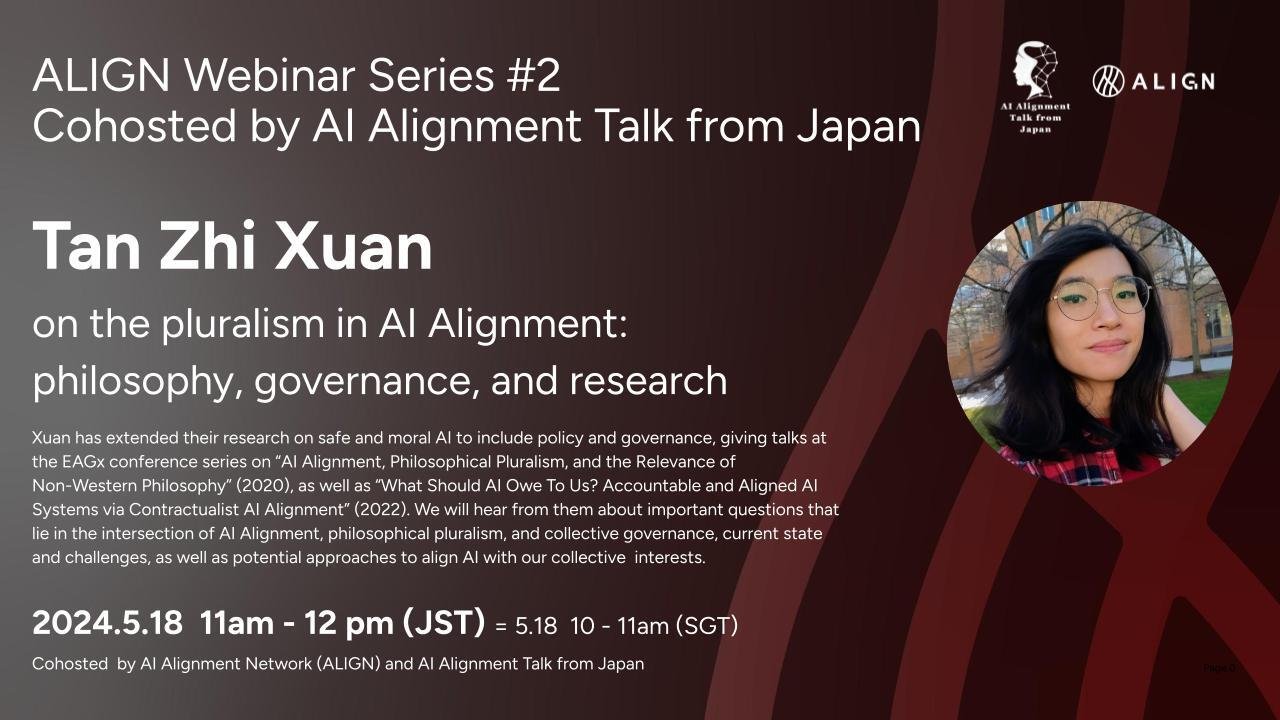

#2 Tan Zhi Xuan on the pluralism in AI Alignment: philosophy, governance, and research

In the second episode of ALIGN webinar series, we invite Tan Zhi Xuan, a PhD candidate in the MIT Probabilistic Computing Project and Computational Cognitive Science labs. We will hear from Xuan about important questions that lie in the intersection of AI Alignment, philosophical pluralism, and collective governance, current state and challenges, as well as potential approaches to align AI with our collective interests.

AI Alignment Talk from Japanとの共催する第2回では、マサチューセッツ工科大学(MIT)Probabilistic Computing Project and Computational Cognitive Science labの博士課程Tan Zhi Xuan氏をお招きし、AIアライメント、哲学的多元主義、ガバナンスの接点に位置する重要な問いをはじめ、現状とその課題、さらにはAIを私たち集団の利益に整合させるためのアプローチについてお話しいただきます。

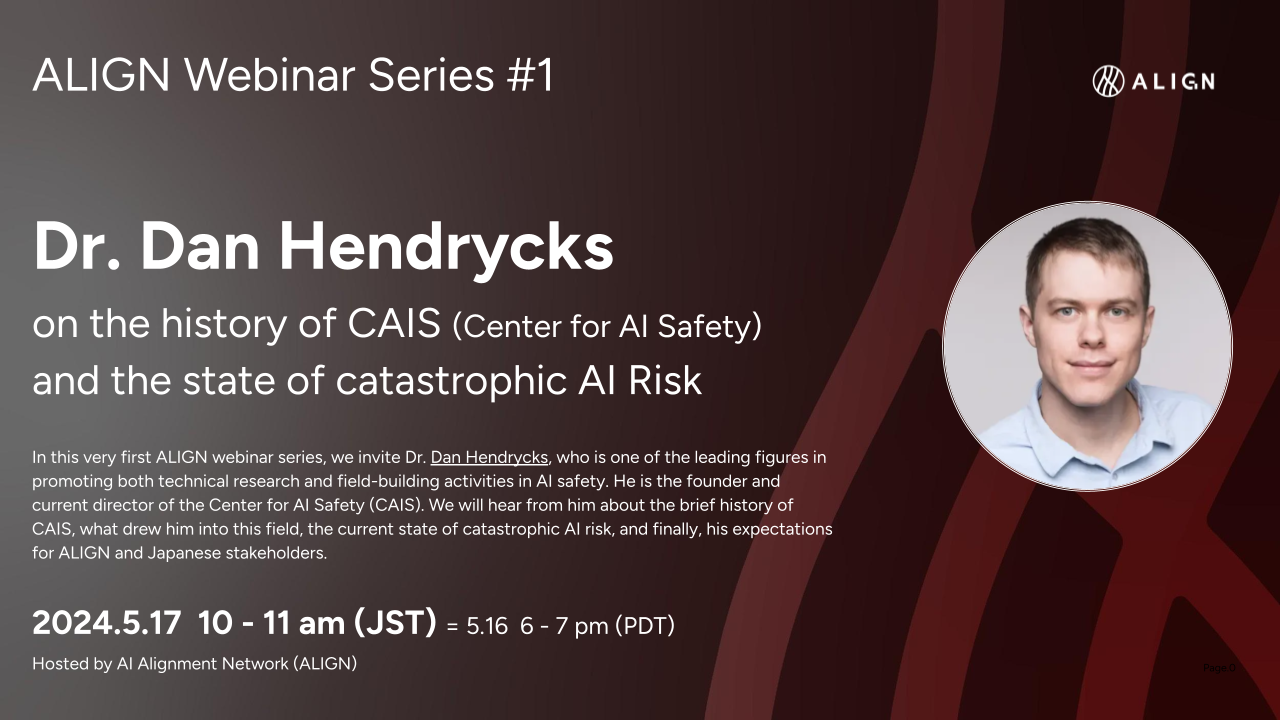

#1 Dr. Dan Hendrycks on the history of CAIS (Center for AI Safety) and the current state of catastrophic AI Risk

In this very first event in of the ALIGN webinar series, we invite Dr. Dan Hendrycks, who is one of the leading figures in promoting both technical research and field-building activities in AI safety. He is the founder and current director of the Center for AI Safety (CAIS).

ALIGN Webinarシリーズの第1回では、Center for AI Safety (CAIS)の創設者あり、AIセーフティの分野の技術的研究や提言活動で世界を先導する一人であるDan Hendrycks(ダン・ヘンドリックス)博士をお招きします。CAISのこれまでの歩み、Hendryck博士がこの分野で活動するに至った経緯、AIが抱えるリスクの現状についてトークいただきます。